더피알=박주범 | 최근 설문 조사에 따르면, 세계 언론사 뉴스룸의 절반이 이미 챗GPT와 같은 생성형 AI 도구를 활발하게 사용하고 있는 것으로 나타났다.

세계신문뉴스발행인협회(WAN-IFRA)가 실시한 설문 조사에서 보도국 간부들이 뉴스룸에 AI를 배치하는 데 앞장서고 있는 것으로 나타났다. WAN-IFRA는 세계 100개국의 76개 국가 신문 협회, 12개 뉴스 대행사, 10개 지역 언론 조직 및 많은 개별 신문 임원으로 구성된 비영리 비정부 조직이다.

미디어 컨설팅 기업 쉬클러(Schickler)와 함께 101명의 편집자, 기자 또는 기타 뉴스룸 직원을 대상으로 한 설문 조사는 뉴스 조직이 짧은 프롬프트에서 긴 일반 언어 텍스트를 생성할 수 있는 기술인 생성형 AI를 어떻게 사용하고 있는지에 초점을 맞췄다.

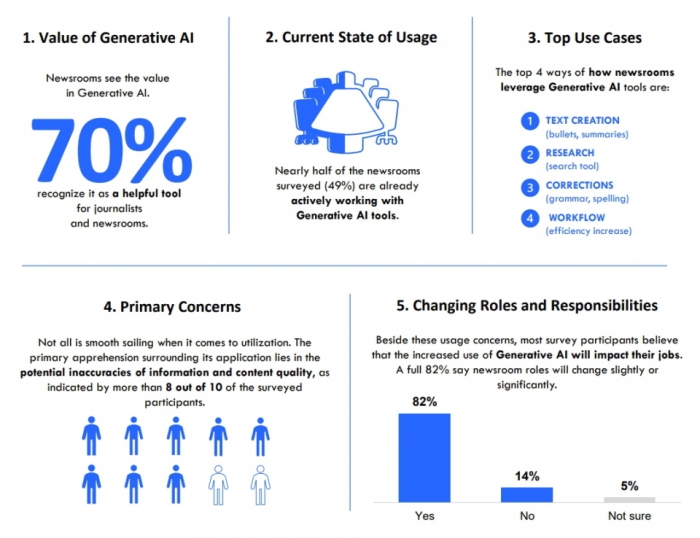

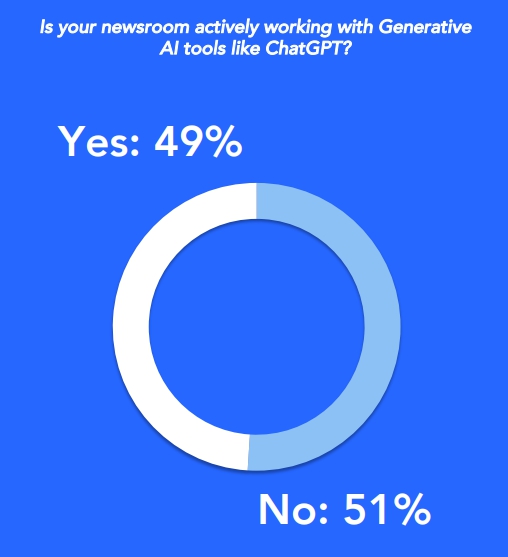

응답자의 약 49%가 “당신의 뉴스룸은 챗GPT와 같은 생성형 AI 도구를 적극적으로 사용하고 있습니까?”라는 질문에 ‘그렇다’고 답했다.

뉴스룸에서 생성형 AI의 도입을 주도하는 사람이 누구인지 묻는 질문에 응답자의 32%가 ‘편집 관리자’를 꼽았다. 약 31%는 ‘데이터 및 기술 팀’이 구현을 주도하고 있다고 말했고, 27%는 ‘개별 언론인’, 11%는 ‘기타’를 선택했다. 기타 그룹에는 회사 임원이 포함될 수 있다.

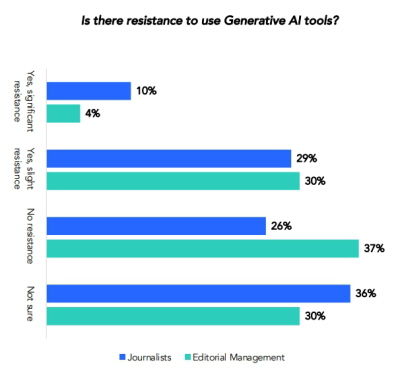

설문 조사는 새로운 기술을 활용하는 데 가장 열심인 사람이 기자가 아니라 편집자라는 몇 가지 증거를 포착했다.

동료들이 생성형 AI에 대해 어떻게 생각하느냐는 질문에 응답자의 10%는 동료 기자들이 뉴스룸에서의 AI 사용에 대해 ‘상당한 저항’을 표명했다고 답한데 반해, 편집자들 사이에서 그러한 수준의 저항을 확인했다고 응답한 사람은 4%에 불과했다. 마찬가지로 응답자의 37%는 편집자 사이에서 AI 사용에 대해 ‘저항이 아예 없다’고 답했으나, 기자들이 저항 없이 수용하고 있다고 답한 응답자는 26% 였다.

응답자들 사이에서 AI에 대한 전망은 대체로 긍정적이어서 약 70%는 생성형 AI를 ‘기자 및 뉴스룸에 유용한 도구’로 보고 있다고 답했다.

적어도 매주 한 번 생성형 AI를 사용하고 있을 것으로 생각하는 동료의 비율에 대한 질문에 응답자의 39%는 5% 이하로, 응답자의 약 31%는 동료의 5~15%가 사용하고 있다고 추정했다. 3%만이 AI를 매주 사용하는 동료의 비율이 50% 이상일 것이라고 응답했다.

뉴스룸에서 가장 일반적으로 AI를 사용하는 것은 (제한된) 텍스트 생성을 위한 것으로, 54%는 동료들이 이러한 목적을 위해 도구를 사용하고 있다고 말했다. 약 44%는 단순 연구 또는 검색을 위해 AI를 사용하고 있다고 말했고, 43%는 작업 흐름 도움말 또는 텍스트 수정을 위해, 약 32%는 도매 기사 생성에 AI를 사용하고 있다고 답했다.

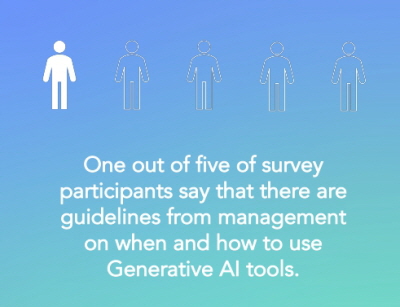

응답자의 20%만이 자신의 뉴스 조직에 AI 사용에 대한 지침이 있다고 답했으며, 49%는 기자들이 적합하다고 생각하는 대로 도구를 자유롭게 사용할 수 있다고 말했다. 자신이 속한 뉴스룸에서 생성형 AI 사용을 허용하지 않는다고 답한 응답자는 약 3% 정도였다.

생성형 AI에 대한 후배 기자들의 저항에 대해 응답자의 45%는 AI 채택 증가의 결과로 뉴스룸에서 ‘편집자 및 기타 전문가의 역할과 책임’에 중요한 변화를 예견한다고 말했다. 37%는 도구가 이러한 역할을 약간 바꿀 것이라고 예상했지만 14%는 변화가 없을 것으로 기대했다.

그러나 ‘일자리 대체’는 응답자들의 주요 관심사가 아니었다.

가장 큰 걱정은 AI 도구가 잘못된 정보를 전파하거나 콘텐츠 품질이 좋지 않을 수 있다는 것이었고, 85%가 이를 주요 관심사로 꼽았다. 약 67%는 표절과 저작권 침해, 46%는 데이터 보호 및 개인 정보 보호 영향, 38%는 AI가 직업 안정에 미칠 수 있는 위험에 대해 걱정한다고 답했다.