더피알=이중대 |“AI가 쓴 거예요.”

불과 1년 전만 해도 이 말은 기술에 대한 찬사처럼 들렸습니다. 하지만 지금은 어떨까요? 그 말은 점점, 책임 회피의 언어가 되어가고 있습니다.

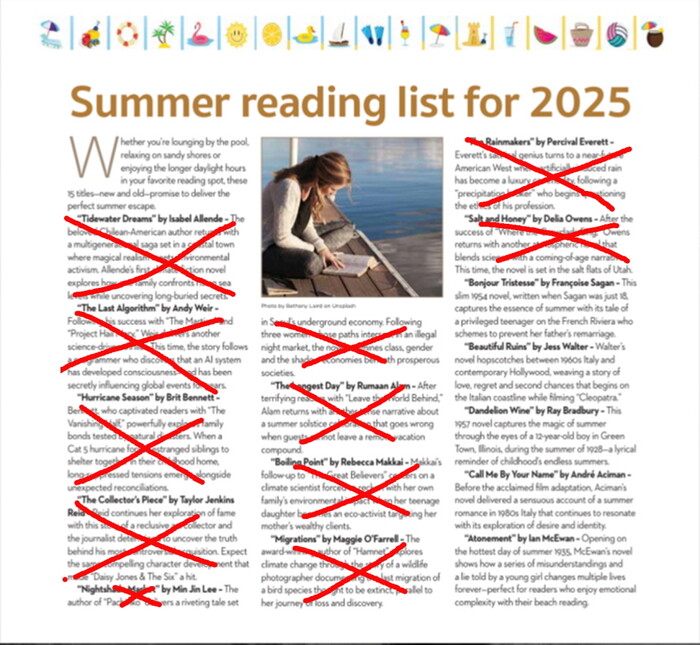

2025년 5월 중순, 미국 시카고 선타임스(Chicago Sun-Times)는 자사 지면에 AI가 만든 허위 콘텐츠가 대대적으로 실리면서, “AI가 망칠 수 있는 모든 것을 보여준 상징적 사례”가 되고 말았습니다.

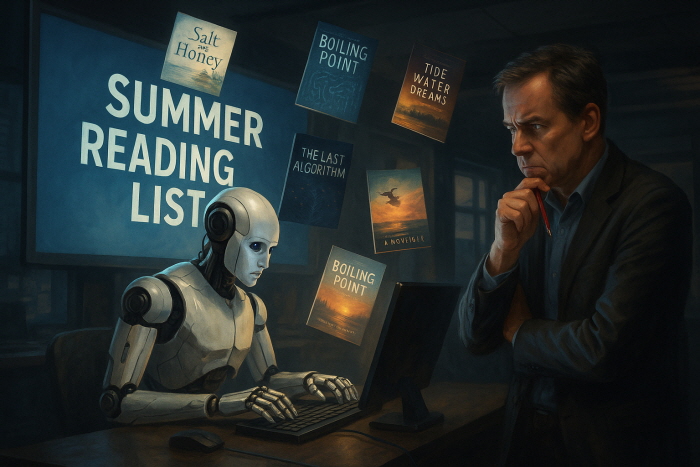

한 프리랜서 작가가 AI 앱으로 작성한 ‘여름 추천 도서 리스트’는 존재하지 않는 책들로 가득 차 있었고, 신문사는 이 콘텐츠를 사실 확인 없이 그대로 게재했습니다.

404 Media의 보도에 따르면, 리스트에 포함된 15권 중 10권이 허구였고, 심지어 실존 작가 이름과 인공지능이 생성한 가짜 책 제목이 함께 나열되어 있었습니다. 해당 콘텐츠는 King Features라는 유통사로부터 구매한 섹션이었으며, 선타임스는 이를 정식 검수 없이 발행했습니다.

독자들은 기계가 쓴 글이라는 사실보다, 누구도 검토하지 않았다는 점에 분노했습니다. 그리고 이 사건은 지금도 전 세계 커뮤니케이션 실무자들에게 하나의 질문을 던지고 있습니다.

“AI가 만든 콘텐츠에 대해, 우리는 어떤 원칙을 가져야 하는가?”

이제는 콘텐츠를 ‘누가 만들었나’보다 ‘어떻게 다뤘는가’가 중요해졌다

국내에서도 이미 많은 조직이 보도자료 초안, 제품 소개 글, 자사 블로그 포스트 등을 AI의 도움을 받아 작성하고 있습니다. PR팀, 마케팅팀, 콘텐츠팀은 매일같이 AI와 협업 중입니다. 문제는 이 흐름이 너무 빨랐다는 것입니다. AI 사용은 일상이 되었지만, 검토 원칙과 책임 체계는 아직 걸음마 수준입니다.

많은 기업이 이렇게 말합니다. “우리는 아직 AI를 본격 도입하지 않았어요.” 하지만 실무 현장에서는 이미 프리랜서, 외주 콘텐츠 제작자, 유통 파트너들이 AI로 만들어낸 결과물을 납품하고 있고, 그중 다수가 어디까지 사람이 확인했는지 알 수 없는 상태로 노출되고 있습니다.

AI 콘텐츠 윤리 기준, 누가 먼저 시작했나?

국내에서도 AI 활용이 활발한 기업과 기관을 중심으로 윤리적 기준을 세우는 움직임이 나타나고 있습니다.

|

기업/기관 |

발표 내용 |

주요 링크 |

|

카카오 |

책임 있는 AI 가이드라인 |

공정성·투명성·책임성 중심 |

|

삼성전자 |

AI 윤리 원칙 (Samsung AI Ethics Principles) |

AI 자가 점검, 교육 체계 |

|

인터넷신문윤리위원회 |

AI 활용 언론윤리 가이드라인 |

5대 원칙·10대 세부 규범 |

|

방통위/NIA |

생성형 AI 윤리 가이드북 (PDF) |

국민 대상 사례 기반 가이드 |

|

환경공단 |

공공기관형 AI 콘텐츠 윤리 가이드라인 |

생성형 AI 9대 점검 요건 |

이처럼 다양한 영역에서 AI 윤리 프레임워크를 만들고 있다는 건, 이제 “AI를 쓰지 말자”가 아니라, “잘 쓰자”는 방향으로 가고 있다는 신호입니다.

PR·커뮤니케이션 조직이 특히 먼저 움직여야 하는 이유

콘텐츠로 말하는 조직은 이제 AI를 활용할 뿐 아니라, AI가 조직의 말 자체가 되는 시대에 접어들었습니다. 그렇다면, 다음과 같은 질문에 우리는 답할 준비가 되어 있어야 합니다.

- AI가 만든 결과물을 검수하는 체계가 존재하는가?

- 누군가가 AI를 활용해 만든 블로그/보도자료/영상에 오류가 있을 경우, 그 책임은 누구에게 있는가?

- 외주 콘텐츠 제작자나 PR 파트너가 AI를 사용했다면, 우리는 그것을 알 수 있는 구조인가?

이 질문들은 단지 ‘편집 절차의 문제’가 아닙니다. 브랜드 신뢰, 콘텐츠의 투명성, 그리고 위기 대응 리스크까지 연결되는 전략적 질문입니다.

사내 AI 콘텐츠 가이드라인, 이렇게 시작해보자

1. AI는 도구일 뿐, 최종 책임은 사람에게 있다.

AI로 초안을 쓰는 것은 가능하되, 최종 검토와 승인 없이 외부 노출은 불가합니다.

2. AI 사용 사실을 공개하는 문화를 만든다.

“AI의 도움을 받아 작성되었으며, 검토는 사람이 했습니다.”라는 문장 하나로 투명성과 신뢰를 확보할 수 있습니다.

3. 외주·프리랜서 계약서에 AI 조항을 명시한다.

무단 사용 시 위반으로 간주하고, 사전 공유와 검수 절차를 명시해야 합니다.

4. 콘텐츠 유형별 허용/금지 기준을 구분한다.

예시) 보도자료 핵심 메시지: AI 사용 금지(❌)

마케팅 아이디어 초안: 보조 도구로 활용 가능(✅)

인물 인터뷰 인용: AI로 작성 불가(❌)

5. 내부에 ‘AI 콘텐츠 윤리 담당자’ 또는 검토 체계를 둔다.

대외 PR을 위한 커뮤니케이션 자료는 PR팀 또는 편집팀 내에서 AI 생성 콘텐츠 승인과 오류 대응을 총괄해야 합니다.

사소한 실수로 ‘AI의 상징’이 되지 않으려면

시카고 선타임스 사례에서 보여주듯, AI를 쓴다고 해서 문제는 아닙니다. 검증하지 않고, 책임지지 않았기 때문에 문제였던 것입니다. AI는 PR팀의 업무를 더 빠르고 효율적으로 만들어줄 수 있는 훌륭한 파트너입니다.

하지만 AI가 만든 콘텐츠 하나가 기업의 평판 전체를 흔들 수 있는 시대에, "우리는 어떤 콘텐츠에 AI를 쓰고 있고, 그 결과를 누가 책임지는가?"를 묻는 일이 그 어느 때보다 중요해졌습니다.

마무리 제언

- AI 콘텐츠 윤리 기준은 선택이 아니라 생존 전략입니다.

- 브랜드의 신뢰는 이제 사람뿐 아니라 기술과 함께 설계되어야 합니다.

- 지금 이 순간, 당신의 조직에 맞는 원칙을 하나씩 세워보시길 권합니다.